dei Ricercatori FUB: Giambattista Amati, Federica Mangiatordi, Simone Angelini, Emiliano Pallotti, Pierpaolo Salvo

Il futuro della mobilità connessa e autonoma poggia su un pilastro invisibile ma fondamentale: la capacità delle reti 5G-Advanced e 6G di gestire comunicazioni Vehicle-to-Everything (V2X) con precisione e affidabilità. In scenari urbani densi – come quello di alcune aree di Roma analizzate nelle ricerche condotte dalla Fondazione Ugo Bordoni nell’ambito del programma PNRR “RESTART” – centinaia di veicoli, infrastrutture stradali (Smart Radio Units RSUs o superfici intelligenti riconfigurabili RIS) e sensori devono scambiare dati critici per la sicurezza in frazioni di secondo. La sfida non è solo tecnologica, ma matematica. La natura estremamente dinamica di queste reti, in cui la topologia cambia ogni millisecondo a causa del movimento dei veicoli e degli ostacoli urbani, rende i metodi tradizionali di gestione delle risorse non solo inefficienti, ma quasi sempre inapplicabili. In questo contesto, l’Intelligenza Artificiale, e in particolare le Graph Neural Networks (GNN), emergono come l’unica soluzione percorribile per risolvere problemi di ottimizzazione complessi, nel rispetto dei vincoli di latenza ultra-bassa (URLLC), come per esempio quelli richiesti dalle applicazioni di guida autonoma. Il contributo della FUB si inserisce proprio in questa frontiera, unendo la fisica delle comunicazioni radio con la potenza dei modelli predittivi su grafi.

L’Intelligenza topologica nelle reti: oltre i limiti dell’ottimizzazione convenzionale

La sfida dell’ottimizzazione e il paradosso della latenza

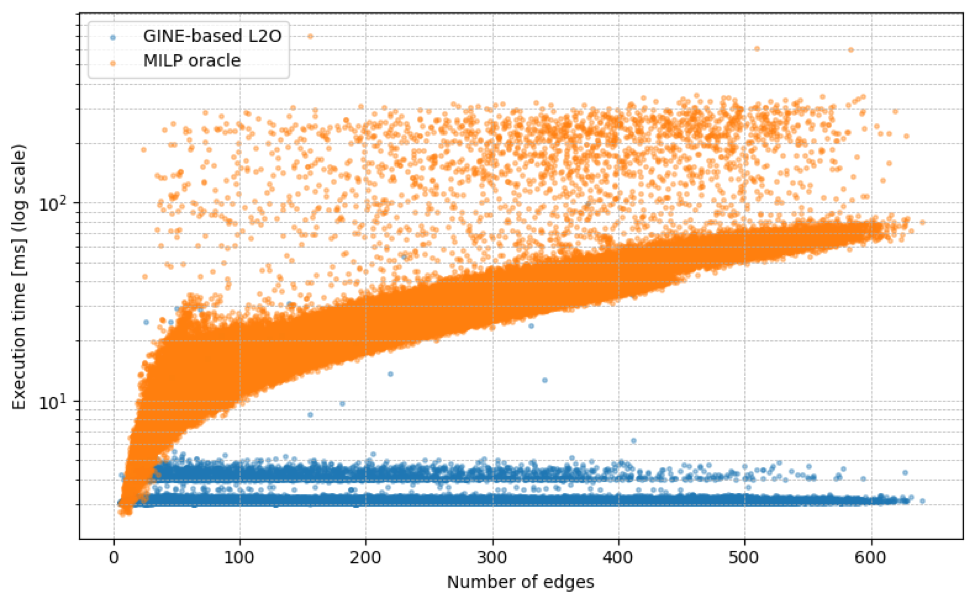

I problemi di allocazione delle risorse nelle reti V2X, come la scelta del miglior canale o del nodo relay per estendere la copertura, ovvero di usare altri veicoli connessi alla rete che facciano da ponte radio ad altri veicoli nel caso che non siano immediatamente connessi alle RSU, sono classificati matematicamente come problemi NP-hard. Risolverli con metodi deterministici convenzionali, come la programmazione lineare intera (MILP), richiederebbe tempi di calcolo che possono richiedere anche secondi o minuti. Si tratta di un’eternità per un veicolo in movimento che deve prendere decisioni in meno di una decina di millisecondi per evitare collisioni o coordinarsi agli incroci. Questo genera un vero e proprio “paradosso dell’ottimizzazione”: i solutori classici sono matematicamente perfetti ma troppo lenti per il tempo reale, mentre le euristiche veloci falliscono sistematicamente in scenari complessi caratterizzati da forti interferenze e signal shadowing.

L’AI modifica il paradigma convenzionale trasformando il problema di ottimizzazione in un problema di apprendimento probabilistico. Invece di cercare la soluzione ottimale da zero per ogni nuova configurazione, i modelli apprendono la struttura sottostante della rete. Le ricerche FUB hanno dimostrato che algoritmi addestrati offline possono operare online con una latenza di inferenza quasi costante meno di 5 millisecondi (3 in architetture più evolute come la GINE che vedremo più avanti), garantendo prestazioni vicine all’ottimo teorico ma con una velocità di esecuzione migliaia di volte superiore ai solutori classici.

Il V2X è nativamente un grafo: l’innovazione dei modelli GINE

Una rete veicolare non può essere modellata efficacemente come una griglia statica. È per sua natura un grafo dinamico dove i veicoli sono i “nodi” e le connessioni radio sono gli “archi”. Mentre le reti neurali tradizionali (le Convolutional Neural Networks CNN) sono insufficienti a catturare le relazioni complesse tra gli elementi, le GNN al contrario sono “physics-aware” e permutazione-equivarianti. La vera innovazione introdotta nei modelli sviluppati dalla FUB riguarda l’uso delle Graph Isomorphism Networks with Edge features (GINE). A differenza delle GNN standard che spesso ignorano gli attributi dei collegamenti, i modelli GINE integrano direttamente la fisica radio (SINR, capacità di Shannon, distanza) all’interno della struttura stessa del grafo, come per esempio:

- Nodi (V): rappresentano veicoli (CAV), unità fisse (RSU) o anche le superfici intelligenti riconfigurabili (RIS), dotati di feature iniziali come coordinate spaziali, carico di traffico richiesto o link attuale attivo.

- Archi (E): rappresentano i link di comunicazione, caratterizzati da parametri cruciali come la qualità del segnale (SNR/SINR) e lo stato di visibilità (LoS/NLoS), tipo di blockage (da vegetazione, altri veicoli o edifici) e così via.

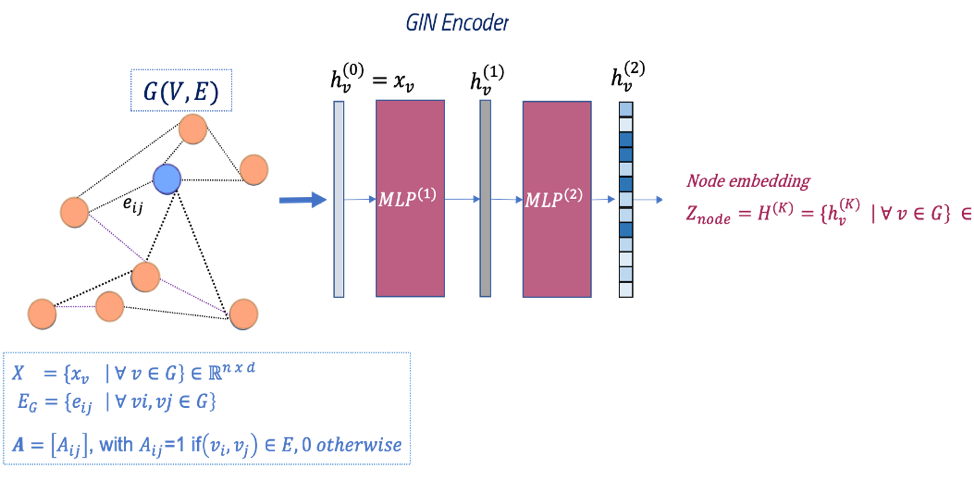

Attraverso un meccanismo di message passing, ogni nodo aggrega le informazioni dai vicini che si propagano a loro volta nella rete, permettendo al sistema di “vedere” la qualità dei link e l’impatto delle interferenze, anche dal punto di vista del singolo nodo (node embedding). Questo approccio proietta la fisica del canale radio direttamente nello spazio delle caratteristiche del modello AI, rendendolo capace di distinguere tra strutture di rete quasi identiche ma con prestazioni radicalmente diverse.

Architettura del modello GINE

Entrando nel dettaglio tecnico, il modello GINE implementato si compone di più layer progettati per elaborare separatamente e poi fondere le informazioni di nodi e archi. Ogni livello prevede tre passaggi matematici critici.

- Proiezione dei Nodi: una trasformazione lineare porta le feature dei nodi dalla dimensione iniziale a quella latente (hidden), diventa cioè un vettore di valori numerici di una dimensione prestabilita. Maggiore è la sua dimensione migliore è la sua capacità di rappresentazione dello stato del grafo, maggiore è il numero di parametri probabilistici della rete neurale e quindi maggiore è la risorsa computazionale ed energetica richiesta in fase di addestramento.

- MLP per Archi: Un Multi-Layer Perceptron dedicato proietta le feature iniziali degli archi (come la capacità di Shannon) nello stesso spazio dimensionale dei nodi. Questo passaggio è fondamentale per garantire che il sistema possa gestire coerentemente le informazioni radio e quelle in possesso dai veicoli.

- GINE Convolution: Il cuore del processo, dove il messaggio ricevuto da un nodo vicino viene calcolato come il valore ReLU (Rectified Linear Unit) della somma tra la rappresentazione del vicino e quella del link che li unisce. La ReLU è necessaria nelle reti neurali per approssimare qualunque funzione da apprendere che non sia semplicemente lineare.

L’aggregazione avviene tramite una funzione di somma, che garantisce la massima capacità discriminativa del modello, equivalente al test di decisione Weisfeiler-Lehman per stabilire l’isomorfismo tra grafi qualunque. Questa architettura complessa, integrata con tecniche standard, come la Batch Normalization e il Dropout, per rendere robusto e stabile il modello, permette di ottenere un embedding finale (l’impronta digitale) che rappresenta l’intero stato della rete veicolare in modo compatto ma estremamente ricco di informazioni.

Autoencoder ed embedding: l’impronta digitale della rete

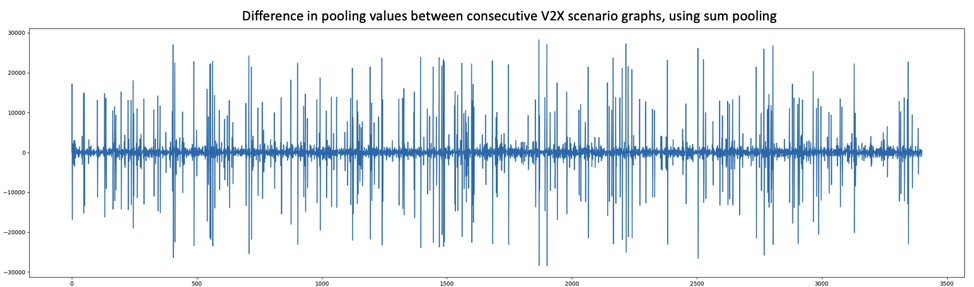

Per gestire la complessità di migliaia di veicoli in movimento, la ricerca FUB ha implementato un’architettura basata su GIN-autoencoder. Questo sistema è composto da un encoder, che comprime la topologia della rete in uno spazio latente compresso e ottiene un’impronta digitale (Z), e un decoder che tenta di ricostruire esattamente il grafo iniziale. Per fare ciò, si minimizza la perdita del processo di ricostruzione del grafo (“Reconstruction Loss”) e così si permette di addestrare il sistema a estrarre solo le informazioni topologiche essenziali. Il risultato è un “embedding del grafo”: un vettore matematico che funge da impronta digitale dello scenario corrente. Mediante l’analisi di questa impronta digitale ottenuta dall’encoder possiamo effettuare:

- Rilevamento di shift topologici: calcolando la variazione dell’embedding tra istanti temporali consecutivi, è possibile identificare istantaneamente cambiamenti critici nel network.

- Handover non supervisionato: un caso d’uso riguarda la gestione degli handover. Monitorando i “salti” nell’embedding di un veicolo, il sistema rileva se la sua connettività sta cambiando radicalmente e di conseguenza decide di effettuare l’handover.

Negli esperimenti condotti, questo framework ha raggiunto un’accuratezza del 93.4% nel rilevare la necessità di un cambio di cella (handover), operando in modo totalmente non supervisionato. Il sistema non aspetta che il segnale degradi sotto una soglia fissa, ma “intuisce” la necessità di spostarsi basandosi sulla dinamica strutturale del grafo.

L’encoder del modello GINE: restituisce l’impronta digitale del grafo (node embedding)

La rappresentazione temporale dei valori del node embedding (impronte digitali per il grafo). Picchi nella variazione del valore di embedding indicano variazioni significative nella topologia del grafo e la necessità di effettuare l’handover per i nodi

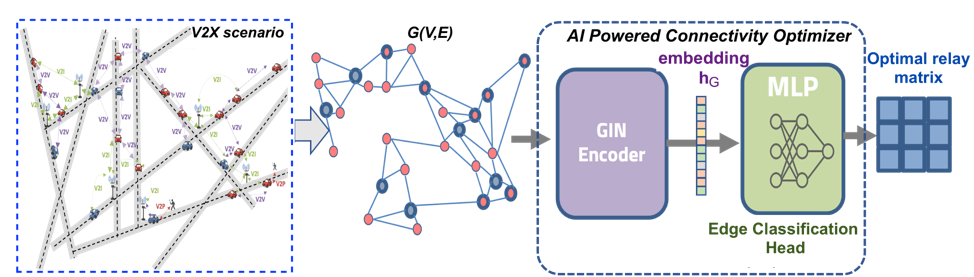

Learning to Optimize (L2O) per la selezione dei relay

Il paradigma Learning to Optimize (L2O) cambia il tipo di architettura AI descritta precedentemente con il paradigma dell’autoencoder. Invece di ricostruire il grafo iniziale con il decoder, la componente del decoder è sostituita da una rete neurale che ricostruisce non il grafo iniziale ma il grafo contenente la soluzione ottimale. L2O rappresenta la risposta definitiva alla lentezza dei solutori matematici. In questo scenario, il modello GINE viene addestrato seguendo un approccio “Teacher-Student”: un potente solutore MILP agisce come insegnante offline, un oracolo, risolvendo migliaia di scenari storici per trovare la matrice di relay ottima. Il modello GINE (lo studente) impara a imitare queste decisioni ottime. Una volta addestrato, lo “studente” può finalmente operare online per prevedere istantaneamente quali veicoli debbano agire da ponti radio per massimizzare la connettività totale. I risultati ottenuti dalla FUB mostrano un impatto risolutivo notevole:

- Precisione di link: una validazione superiore al 95% nella previsione dei collegamenti ottimali.

- Guadagno di connettività: un aumento medio del 9.2%, in confronto al 12.3% dell’ottimizzatore MILP, nel numero di veicoli connessi con successo alla rete, specialmente in “urban canyons” dove il segnale diretto verso l’infrastruttura sarebbe bloccato dagli edifici.

- Efficienza decisionale: mentre il solutore convenzionale MILP impiega secondi che crescono esponenzialmente con la complessità della rete, il modello L2O mantiene un tempo di inferenza costante minore dei 5ms, rendendo possibile la gestione di reti con centinaia di archi in tempo reale.

L’architettura AI di GINE per la costruzione della matrice delle connessioni relay

I tempi sono in scala logaritmica. L2O ha tempi quasi trascurabili e quasi costanti in confronto al decisore matematico MILP

Strategie ibride e pruning del dominio di ricerca

Un aspetto fondamentale della ricerca riguarda la flessibilità dell’approccio L2O. Non sempre è necessario sostituire completamente l’ottimizzatore matematico; a volte, l’AI può agire come un filtro intelligente per potenziare i metodi classici. Questa strategia, definita “Hybrid Intelligence” o GP-MILP (Gine Pruned–MILP), utilizza il modello GINE per effettuare un “pruning” aggressivo dello spazio di ricerca. In pratica, l’AI analizza il grafo e rimuove il 99% dei link improbabili o inefficienti. Il solutore MILP deve quindi lavorare solo sul restante 1% degli archi del grafo. Questo approccio combinato permette di ottenere il meglio dai due mondi: la garanzia matematica di ottimalità del MILP e la velocità dell’AI. I test hanno confermato che il 98% degli scenari di rete può essere risolto in meno di 30 millisecondi con la soluzione ottima garantita. Questa tecnica è particolarmente utile in fasi di transizione tecnologica o di sicurezza, dove la fiducia nelle decisioni puramente basate su reti neurali deve essere ancora consolidata da verifiche formali, garantendo al contempo la reattività necessaria per le reti 5G e 6G.

Combinando il MILP a cascata dopo il pruning effettuato dall’AI con L2O si è in grado di scegliere la soluzione ottima con tempi di decisione sotto i 35ms per il 98% dei casi.

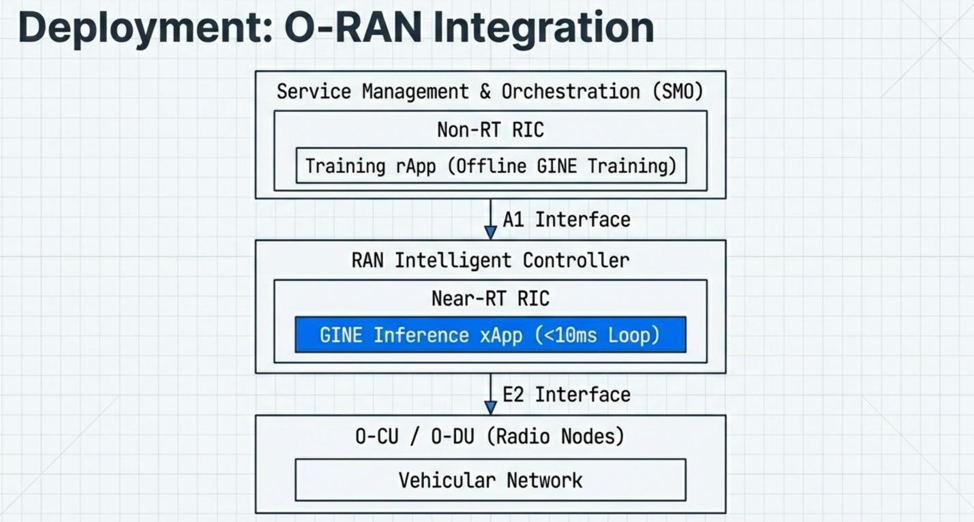

Integrazione O-RAN: dalla ricerca alla distribuzione reale

L’ultima fase del percorso di innovazione riguarda l’implementazione di queste soluzioni nell’architettura di rete, come O-RAN (Open Radio Access Network). Grazie al design modulare di O-RAN, i modelli di Graph Learning della FUB possono essere integrati come applicazioni intelligenti:

- Non-RT RIC: all’interno del controller non in tempo reale, rApp dedicate gestiscono l’addestramento offline dei modelli GINE utilizzando i dati storici e i “Digital Twins” della rete urbana.

- Near-RT RIC: i modelli addestrati vengono poi installati nel controller radio vicino che opera in tempo reale tramite xApp. Qui, operando in un loop inferiore ai 10ms, le xApp eseguono l’inferenza sui dati provenienti dai nodi radio (O-CU/O-DU), ottimizzando dinamicamente l’allocazione dello spettro e gli handover.

Come integrare il paradigma L2O per grafi nell’architettura O-RAN

Dove altro applicare il modello AI di GINE

Il nostro approccio ha tre caratteristiche che lo rendono facilmente generalizzabile ed esportabile in altri tipi di contesti:

- Invarianza e Equivarianza: i modelli GINE scala facilmente rispetto alla dimensione della rete. I modelli GINE assicurano che l’output sia invariante rispetto all’ordine arbitrario dei nodi (invarianza per permutazioni), permettendo di applicare lo stesso modello a reti di dimensioni diverse (da pochi nodi a migliaia) senza dover riaddestrare la rete.

- Integrazione delle variabili fisiche: Il modello GINE proietta le caratteristiche degli archi (che siano parametri radio o costi logistici) nello stesso spazio dimensionale dei nodi, permettendo al sistema di “sentire” la qualità di ogni singola interazione nel grafo.

- Flessibilità O-RAN: l’integrazione proposta nell’architettura O-RAN tramite xApp e rApp dimostra come questi modelli possano essere inseriti in flussi di controllo sia in tempo reale (near-RT) che strategici (non-RT).

Questa architettura abilita quindi una generalizzazione trasversale dell’approccio Learning to Optimize (L2O), superando i confini delle reti veicolari puramente terrestri. La forza dei modelli basati su grafi, e in particolare della variante GINE, risiede nella loro capacità di essere agnostici rispetto alla topologia specifica e intrinsecamente capaci di gestire strutture dati non-Euclidee e irregolari.

Grazie a queste proprietà matematiche, lo stesso framework può essere scalato con successo verso scenari di comunicazione terrestre e non-terrestre (NTN) o Content Delivery Networks (CDN):

- UAV e Satelliti LEO: la capacità delle GINE di catturare interdipendenze spaziali e adattarsi a topologie altamente dinamiche le rende ideali per ottimizzare la connettività in sciami di droni (UAV) o in costellazioni di satelliti a orbita bassa (LEO), dove i link sono variabili e i cambiamenti strutturali avvengono frequentemente.

- Content Delivery Networks (CDN): l’approccio può essere esteso alle reti di distribuzione dei contenuti, dove nodi (server e cache) e archi (flussi di dati e latenze) formano un grafo complesso. In questo ambito, l’L2O può ottimizzare in tempo reale la collocazione delle risorse e il routing del traffico, agendo come uno strumento di decisione scalabile e affidabile.

- Catene del valore e settori economici: Oltre l’ambito strettamente TLC, la flessibilità del paradigma di message-passing permette di modellare sistemi economici complessi. Per esempio, in una catena del valore, gli attori (fornitori, produttori, distributori) possono essere rappresentati come nodi e le loro interazioni (scambi economici, flussi logistici) come archi; il modello AI può così identificare colli di bottiglia o ottimizzare l’efficienza sistemica, garantendo resilienza agli shock di rete proprio come avviene per le interferenze radio nel V2X.

In sintesi, l’intelligenza topologica fornisce un framework robusto per la self-configuration e l’auto-ottimizzazione di qualsiasi sistema complesso che possa essere rappresentato come un insieme di entità interagenti.

Conclusioni e ruolo della ricerca FUB verso il 6G

Il lavoro svolto dalla Fondazione Ugo Bordoni dimostra come l’AI topologica non sia più solo un’opzione teorica, ma una necessità operativa per le reti di prossima generazione. Attraverso l’uso di GINE e del paradigma Learning to Optimize è possibile superare il muro della complessità computazionale, offrendo connettività resiliente e sicura anche negli ambienti più complessi. La capacità di trasformare una rete di comunicazione in embedding di grafi permette di intravedere come realizzare reti con capacità di recupero adattivo (self-healing), ovvero capaci di riconfigurarsi istantaneamente in caso di perdita di segnale o congestione improvvisa. Il V2X è solo un caso di studio delle comunicazioni di prossima generazione. L’integrazione di questi modelli nell’architettura O-RAN non solo tramite i Radio Intelligent Controllers (RIC) ma anche in una prospettiva di calcolo “edge”, cioè periferico e distribuito, fornirebbe inoltre un percorso concreto per implementare questi modelli in ottica 6G. Sono stati affrontati due problemi chiave in questo tipo di comunicazione, l’handover e il relay degli stessi veicoli, ma esistono ancora altre sfide da esplorare, come la robustezza dei modelli rispetto a dati incompleti e quindi l’apprendimento sul campo non solo da dati e soluzioni perfette, ma da dati rumorosi o da soluzioni non sempre ottime. Tuttavia, la strada è tracciata: l’interazione tra copie digitali (Digital Twin) della rete, GNN spazio-temporali e algoritmi di rinforzo rappresenta il prossimo traguardo per rendere le reti 6G non solo più veloci, ma davvero autonome e resilienti. L’obiettivo finale è una rete che non sia solo un canale di trasmissione, ma una rete intelligente capace di comprendere e anticipare la propria evoluzione spaziale e temporale.

Questo lavoro è stato sostenuto dall’Unione Europea nell’ambito del Piano Nazionale di Ripresa e Resilienza (PNRR) italiano di NextGenerationEU, partnership su ‘Telecomunicazioni del futuro’ (PE00000001 – programma ‘RESTART’).

Riferimenti

- G. Amati, F. Mangiatordi, E. Pallotti, S. Angelini and P. Salvo, “Topology Intelligence: GNN-Powered 5G V2X,” 2025 AEIT International Annual Conference (AEIT), Amantea (CS), Italy, 2025, pp. 1-6, doi: 10.23919/AEIT67669.2025.

11218058.

- G. Amati, F. Mangiatordi, E. Pallotti, S. Angelini and P. Salvo, “5G-V2X Topology Intelligence: A GNN Approach“, 2025 17th International Congress on Ultra Modern Telecommunications and Control Systems and Workshops (ICUMT), Florence, Italy, 2025, pp. 7-12, doi: 10.1109/ICUMT67815.2025.

11268640.

- G. Amati, S. Angelini, F. Mangiatordi, E. Pallotti and P. Salvo, “A Massive Clustering Algorithm for Fast Radio Resource Allocation to Distributed Units in O-RAN Networks“, 2024 AEIT International Annual Conference (AEIT), Trento, Italy, 2024, pp. 1-6, doi: 10.23919/AEIT63317.2024.

10736694.

- Giambattista Amati, Federica Mangiatordi, Simone Angelini, Emiliano Pallotti, and Pierpaolo Salvo, “Learning-to-Optimize Graph Framework for Real-Time Relay-Link Optimization in NR-V2X“, in Proceedings of the 2026 IEEE International Conference on Machine Learning for Communication and Networking (ICMLCN), 2026. Accepted for publication.